Prompt教程-知识生成

知识生成

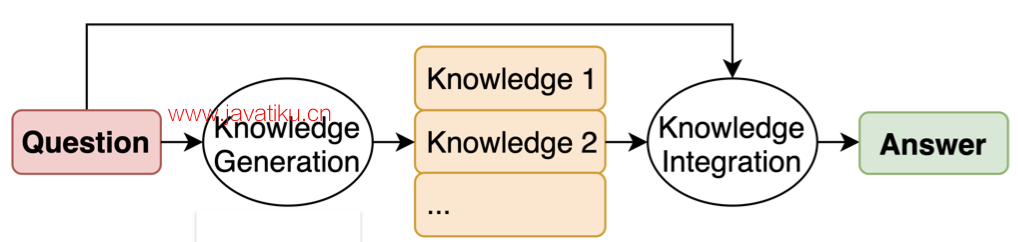

生成的知识方法(Generated Knowledge Approach)要求 LLM 在生成响应之前生成与问题相关的可能有用的信息。该方法由两个中间步骤组成,即知识生成和知识集成。

知识生成(Liu et al.)

知识生成

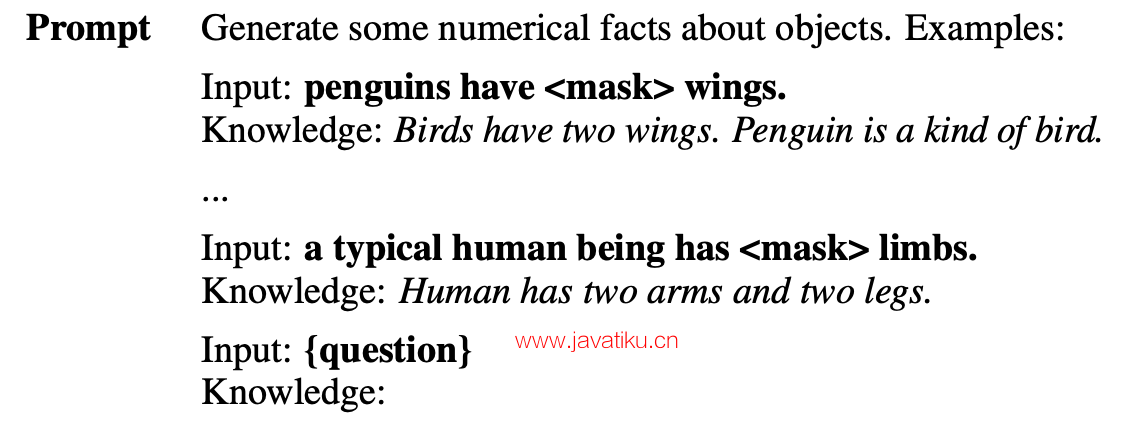

在知识生成步骤中,要求 LLM 生成有关问题的一组事实。大语言模型将以 few-shot 方式进行提示,如下所示。使用相同提示生成 M 个不同的完成。

生成的知识示例(Liu et al.)

知识集成

接下来,我们将使用"知识增强"的问题提示方法来集成知识,并通过提示语言模型(LLM)获取最终答案。为了更好地理解这个过程,我们通过一个例子来说明。

假设我们要回答问题:"大多数袋鼠有 <mask> 肢体"。在知识生成步骤中,我们生成了两个知识(M=2):

- 知识1:"袋鼠是生活在澳大利亚的有袋动物。"

- 知识2:"袋鼠是有5条肢体的有袋动物。"

现在,我们将每个知识与问题连接起来,生成知识增强的问题:

- 知识增强问题1:"大多数袋鼠有 <mask> 肢体。袋鼠是生活在澳大利亚的有袋动物。"

- 知识增强问题2:"大多数袋鼠有 <mask> 肢体。袋鼠是有5条肢体的有袋动物。"

然后,我们使用这些知识增强的问题作为提示,输入到语言模型中,并获得关于最终答案的建议:

- 建议1:"4"

- 建议2:"5"

我们选择具有最高概率的答案作为最终答案。最高概率可能是指答案标记的softmax概率,或者是答案标记的对数概率。

通过这种知识集成的方法,我们能够更好地利用常识和先前生成的知识,从而提高对各种常识数据集的答案准确性和一致性。

结论

这种方法显示出对各种常识数据集的改进,通过集成多个知识来提高答案的质量和可靠性。知识集成是一种有力的方法,可以在语言模型中引入外部知识,并将其与问题集成,从而提供更准确和全面的答案。