Prompt教程-音乐生成

音乐生成

音乐生成的潜力越来越受到欢迎,并有望对音乐产业产生重大影响。

音乐生成模型能够创作和生成和弦、旋律或完整歌曲,它们可以按照特定类型构建和创建音乐,并以特定艺术家的风格进行作曲或即兴演奏。

然而,尽管音乐模型有巨大的潜力,但目前仍存在一些挑战。与图像或文本生成模型相比,音乐模型往往难以进行详细的指导,并且生成的输出通常不能像其他模型那样进行全面的自定义。

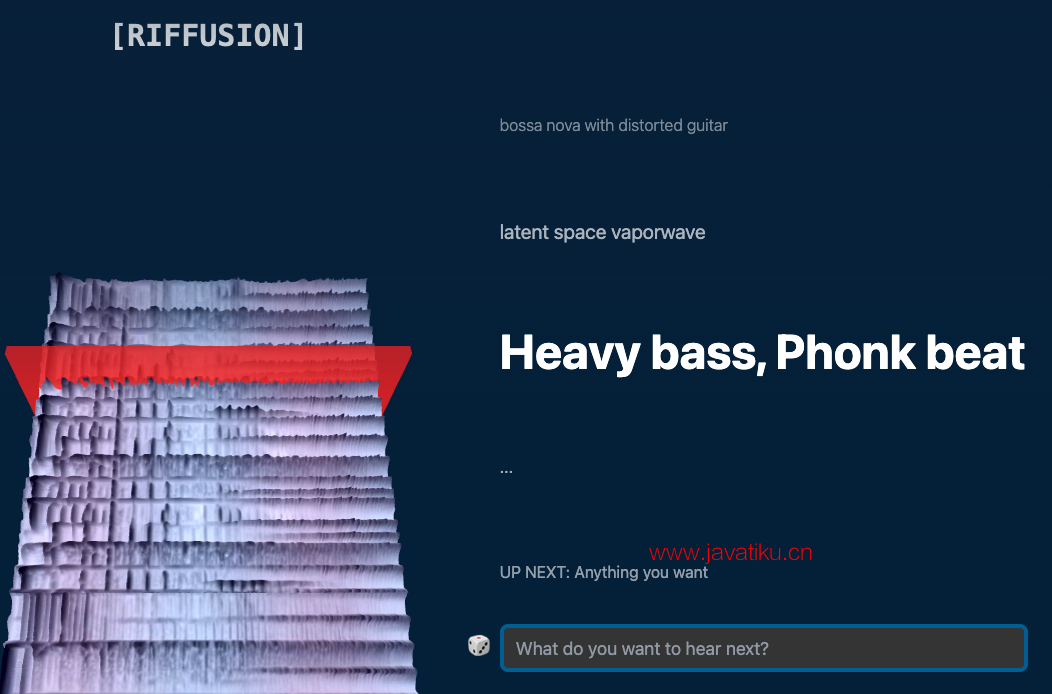

Riffusion

Riffusion(@Forsgren_Martiros_2022)是 Stable Diffusion 的精细调整版本,可以通过提示进行控制,生成乐器和伪风格,但拥有的节拍数量有限。

Mubert

Mubert似乎通过情感分析来解释提示,并将适当的音乐风格与提示相关联,但不能通过提示详细控制音乐参数。目前尚不清楚有多少结果是由AI完成的。

其他

还有一些尝试将GPT-3用作Text-2-Music工具,并使用实际的提示来获取音乐元素的"微观"级别(而不是像Mubert和Riffusion生成的相对模糊的提示样式类比)。例如,可以使用提示如"编写一个只使用A、B、C#、F#和G的民谣风格的音符"。然而,目前这些尝试仅限于单个乐器。

其他方法包括使用模型链,将任何图像转换为代表其声音的形式,以及使用ChatGPT生成创建声音的Python库代码的提示。