Scrapy打造搜索引擎 畅销3年的Python分布式爬虫视频资料教程

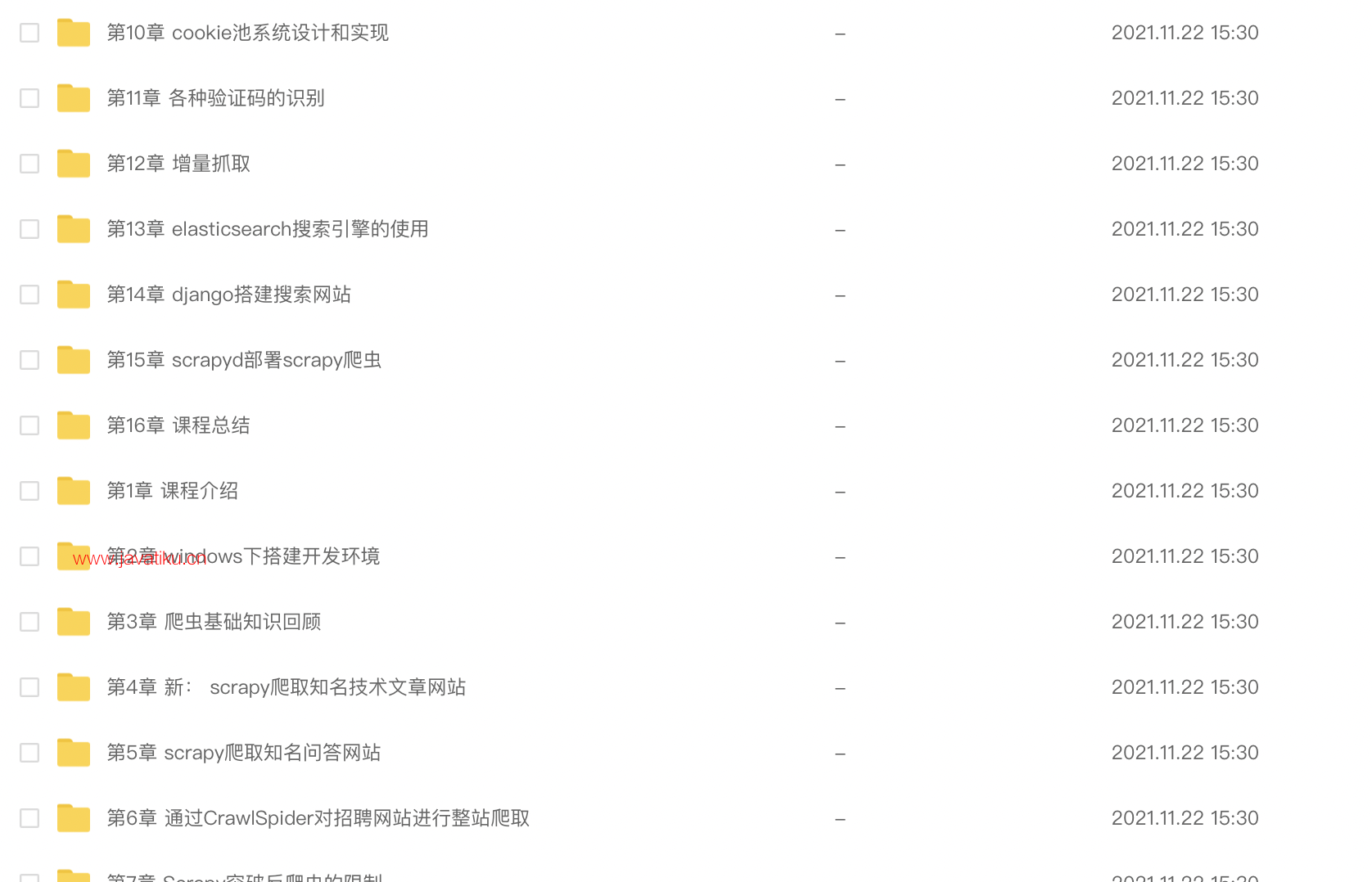

目录

第1章 课程介绍 1 节

介绍课程目标、通过课程能学习到的内容、和系统开发前需要具备的知识

1-1 python分布式爬虫打造搜索引擎简介 (07:23)

第2章 windows下搭建开发环境4 节

介绍项目开发需要安装的开发软件、 python虚拟virtualenv和 virtualenvwrapper的安装和使用、 最后介绍pycharm和navicat的简单使用

2-1 pycharm的安装和简单使用 (09:07)

2-2 mysql和navicat的安装和使用 (16:20)

2-3 windows和linux下安装python2和python3 (06:49)

2-4 虚拟环境的安装和配置 (30:53)

第3章 爬虫基础知识回顾7 节

介绍爬虫开发中需要用到的基础知识包括爬虫能做什么,正则表达式,深度优先和广度优先的算法及实现、爬虫url去重的策略、彻底弄清楚unicode和utf8编码的区别和应用。

3-1 技术选型 爬虫能做什么 (09:50)

3-2 正则表达式-1 (18:31)

3-3 正则表达式-2 (19:04)

3-4 正则表达式-3 (20:16)

3-5 深度优先和广度优先原理 (25:15)

3-6 url去重方法 (07:44)

3-7 彻底搞清楚unicode和utf8编码 (18:31)

第4章 新: scrapy爬取知名技术文章网站25 节

搭建scrapy的开发环境,本章介绍scrapy的常用命令以及工程目录结构分析,本章中也会详细的讲解xpath和css选择器的使用。然后通过scrapy提供的spider完成所有文章的爬取。然后详细讲解item以及item loader方式完成具体字段的提取后使用scrapy提供的pipeline分别将数据保存到json文件以及mysql数据库中。…

4-1 重录说明(很重要!!!) (04:47)

4-2 scrapy安装和配置 (30:30)

4-3 需求分析 (13:53)

4-4 pycharm中调试scrapy源码 (10:13)

4-5 xpath基础语法 (19:02)

4-6 xpath提取元素 (28:48)

4-7 css选择器 (17:54)

4-8 编写spider完成抓取过程 – 1 (19:38)

4-9 编写spider完成抓取过程 – 2 (20:47)

4-10scrapy中为什么要使用yield (09:49)

4-11 提取详情页信息 (23:16)

4-12 提取详情页信息 (18:13)

4-13 items的定义和使用 – 1 (16:21)

4-14 items的定义和使用 – 2 (13:30)

4-15 scrapy配置图片下载 (18:20)

4-16 items数据写入到json文件中 (09:27)

4-17 mysql表结构设计 (13:21)

4-18 pipeline数据库保存 (20:16)

4-19 异步方式入库mysql (12:37)

4-20 数据插入主键冲突的解决方法 (04:40)

4-21 itemloader提取信息 (21:41)

4-22 itemloader提取信息 (19:06)

4-23 大规模抓取图片下载出错的问题 (12:45)

第5章 scrapy爬取知名问答网站11 节

通过上一章节的学习,本章节我们将对具体的网站进行需求分析、表结构设计等、本章详细的分析了网站的网络请求并分别分析出了网站问题回答的api请求接口并将数据提取出来后保存到mysql中

5-1 session和cookie自动登录机制

5-2 selenium模拟登录知乎 – 1new

5-3 selenium模拟登录知乎-2new

5-4 selenium模拟登录知乎-3new

5-5 知乎倒立文字识别 new

5-6 selenium自动识别验证码完成模拟登录-1new

5-7 selenium自动识别验证码完成模拟登录 – 2 new

5-8 requests模拟登陆知乎 – 1(可选观看)

5-9 requests模拟登陆知乎 – 2(可选观看)

5-10 requests模拟登陆知乎 – 3(可选观看)

5-11 scrapy模拟知乎登录(可选观看)

5-12 知乎分析以及数据表设计-1

5-13 知乎分析以及数据表设计-2

5-14 item loder方式提取question – 1

5-15 item loder方式提取question – 2

5-16 item loder方式提取question – 3

5-17 知乎spider爬虫逻辑的实现以及answer的提取 – 1

5-18 知乎spider爬虫逻辑的实现以及answer的提取 – 2

5-19 保存数据到mysql中 -1

5-20 保存数据到mysql中 -2

5-21 保存数据到mysql中 -3

第6章 通过CrawlSpider对招聘网站进行整站爬取9 节

本章完成招聘网站职位的数据表结构设计,并通过link extractor和rule的形式并配置CrawlSpider完成招聘网站所有职位的爬取,本章也会从源码的角度来分析CrawlSpider让大家对CrawlSpider有深入的理解。

6-1 数据表结构设计 (15:33)

6-2 CrawlSpider源码分析-新建CrawlSpider与settings配置 (12:50)

6-3 CrawlSpider源码分析 (25:29)

6-4 Rule和LinkExtractor使用 (14:28)

6-5 网页302之后的模拟登录和cookie传递(网站需要登录时学习本视频教程) (32:11)

6-6 item loader方式解析职位 (24:46)

6-7 职位数据入库-1 (19:01)

6-8 职位信息入库-2 (11:19)

6-9 网站反爬突破 (10:58)

第7章 Scrapy突破反爬虫的限制 10 节

本章会从爬虫和反爬虫的斗争过程开始讲解,然后讲解scrapy的原理,然后通过随机切换user-agent和设置scrapy的ip代理的方式完成突破反爬虫的各种限制。本章也会详细介绍httpresponse和httprequest来详细的分析scrapy的功能,最后会通过云打码平台来完成在线验证码识别以及禁用cookie和访问频率来降低爬虫被屏蔽的可能性。…

7-1 爬虫和反爬的对抗过程以及策略 (20:17)

7-2 scrapy架构源码分析 (10:45)

7-3 Requests和Response介绍 (10:18)

7-4 通过downloadmiddleware随机更换user-agent-1 (17:00)

7-5 通过downloadmiddleware随机更换user-agent – 2 (17:13)

7-6 scrapy实现ip代理池 – 1 (16:51)

7-7 scrapy实现ip代理池 – 2 (17:39)

7-8 scrapy实现ip代理池 – 3 (18:46)

7-9 云打码实现验证码识别 (22:37)

第8章 scrapy进阶开发12 节

本章将讲解scrapy的更多高级特性,这些高级特性包括通过selenium和phantomjs实现动态网站数据的爬取以及将这二者集成到scrapy中、scrapy信号、自定义中间件、暂停和启动scrapy爬虫、scrapy的核心api、scrapy的telnet、scrapy的web service和scrapy的log配置和email发送等。 这些特性使得我们不仅只是可以通过scrapy来完成…

8-1 selenium动态网页请求与模拟登录知乎 (21:24)

8-2 selenium模拟登录微博, 模拟鼠标下拉 (11:06)

8-3 chromedriver不加载图片、phantomjs获取动态网页 (09:59)

8-4 selenium集成到scrapy中 (19:43)

8-5 其余动态网页获取技术介绍-chrome无界面运行、scrapy-splash、selenium-grid, splinter (07:50)

8-6 scrapy的暂停与重启 (12:58)

8-7 scrapy url去重原理 (05:45)

8-8 scrapy telnet服务 (07:37)

8-9 spider middleware 详解 (15:25)

8-10 scrapy的数据收集 (13:44)

8-11 scrapy信号详解 (13:05)

8-12 scrapy扩展开发 (13:16)

第9章 scrapy-redis分布式爬虫9 节

Scrapy-redis分布式爬虫的使用以及scrapy-redis的分布式爬虫的源码分析, 让大家可以根据自己的需求来修改源码以满足自己的需求。最后也会讲解如何将bloomfilter集成到scrapy-redis中。

9-1 分布式爬虫要点 (08:39)

9-2 redis基础知识 – 1 (20:31)

9-3 redis基础知识 – 2 (15:58)

9-4 scrapy-redis编写分布式爬虫代码 (21:06)

9-5 scrapy源码解析-connection.py、defaults.py- (11:05)

9-6 scrapy-redis源码剖析-dupefilter.py- (05:29)

9-7 scrapy-redis源码剖析- pipelines.py、 queue.py- (10:41)

9-8 scrapy-redis源码分析- scheduler.py、spider.py- (11:52)

9-9 集成bloomfilter到scrapy-redis中 (19:30)

第10章 cookie池系统设计和实现15 节

为了让爬取代码和解析代码不会受到模拟登录的影响,将模拟登录独立成独立的服务变得很重要,cookie池就是为了解决这类问题而生,多账号登录管理、如何让网站接入变得容易都会是cookie池需要解决的问题。本章节就重点解决cookie池设计和开发的细节问题。 …

10-1 什么是cookie池? (11:27)

10-2 cookie池系统设计 (09:23)

10-3 实现cookie池-1 (10:12)

10-4 实现cookie池-2 (12:39)

10-5 改造login方法 – 1 (09:58)

10-6 改造login方法 – 2 (09:36)

10-7 改造login方法-3 (08:43)

10-8 改造login方法-4 (10:37)

10-9 通过抽象基类实现网站轻松接入 (15:00)

10-10 实现检测网站cookie是否有效 (08:06)

10-11 如何选择redis的数据结构来保存cookie (10:59)

10-12 cookie管理器的实现 (22:10)

10-13 启动cookie池服务 (12:35)

10-14 将cookie集成到爬虫项目中 (15:34)

10-15 cookie架构设计改进意见 (07:36)

第11章 各种验证码的识别5 节

滑动验证码变得越来越流行,如何解决滑动验证码就成为了模拟登录中重要的一个环节,本章节聚焦解决滑动验证码的各种细节问题。

11-1 滑动验证码的识别思路 (15:17)

11-2 验证码截屏-1 (11:42)

11-3 验证码截屏-2 (14:03)

11-4 计算出滑动的距离 (17:37)

11-5 计算滑动轨迹 (18:00)

第12章 增量抓取4 节

增量抓取和数据更新是爬虫运行中经常遇到的问题,比如当前爬虫正在运行,但是新增的数据如何及时发现,如何将后来的url先进行抓取,如何发现新数据都是实际开发中经常原道的问题,本章节通过修改scrapy-redis的源码以最小的代价来解决上诉问题,通过本章节的学习我们将会更加懂得如何去控制爬虫的运行环节。…

12-1 增量爬虫需要解决的问题 (09:36)

12-2 通过修改scrapy-redis完成增量抓取 -1 (16:11)

12-3 通过修改scrapy-redis完成增量抓取-2 (14:13)

12-4 爬虫数据更新 (09:23)

第13章 elasticsearch搜索引擎的使用13 节

本章将讲解elasticsearch的安装和使用,将讲解elasticsearch的基本概念的介绍以及api的使用。本章也会讲解搜索引擎的原理并讲解elasticsearch-dsl的使用,最后讲解如何通过scrapy的pipeline将数据保存到elasticsearch中。

13-1 elasticsearch介绍 (18:21)

13-2 elasticsearch安装 (13:24)

13-3 elasticsearch-head插件以及kibana的安装 (24:09)

13-4 elasticsearch的基本概念 (12:15)

13-5 倒排索引 (11:24)

13-6 elasticsearch 基本的索引和文档CRUD操作 (18:44)

13-7 elasticsearch的mget和bulk批量操作 (12:36)

13-8 elasticsearch的mapping映射管理 (21:03)

13-9 elasticsearch的简单查询 – 1 (14:56)

13-10 elasticsearch的简单查询 – 2 (11:12)

13-11 elasticsearch的bool组合查询 (22:58)

13-12 scrapy写入数据到elasticsearch中 – 1 (14:16)

13-13 scrapy写入数据到elasticsearch中 – 2 (11:15)

第14章 django搭建搜索网站9 节

本章讲解如何通过django快速搭建搜索网站, 本章也会讲解如何完成django与elasticsearch的搜索查询交互。

14-1 es完成搜索建议-搜索建议字段保存 – 1 (13:45)

14-2 es完成搜索建议-搜索建议字段保存 – 2 (13:34)

14-3 django实现elasticsearch的搜索建议 – 1 (19:57)

14-4 django实现elasticsearch的搜索建议 – 2 (18:15)

14-5 django实现elasticsearch的搜索功能 -1 (14:06)

14-6 django实现elasticsearch的搜索功能 -2 (13:14)

14-7 django实现搜索结果分页 (09:12)

14-8 搜索记录、热门搜索功能实现 – 1 (14:34)

14-9 搜索记录、热门搜索功能实现 – 2 (14:04)

第15章 scrapyd部署scrapy爬虫1 节

本章主要通过scrapyd完成对scrapy爬虫的线上部署。

15-1 scrapyd部署scrapy项目 (24:39)

第16章 课程总结4 节

重新梳理一遍系统开发的整个过程, 让同学对系统和开发过程有一个更加直观的理解

16-1 课程总结 (05:55)

反爬虫抓取,人机验证,请输入验证码查看内容:

反爬虫抓取,人机验证,请输入验证码查看内容: